人体的行为是多变而复杂的,具有任何机械都无法做到的柔韧性和多样性,针对人体行为分析和识别的技术是人工智能和模式识别领域的新兴研究方向。在医学康复工程、体感游戏、影视、虚拟现实、专业运动分析等许多方面,人体行为分析和识别的技术获得广泛应用并产生巨大价值。

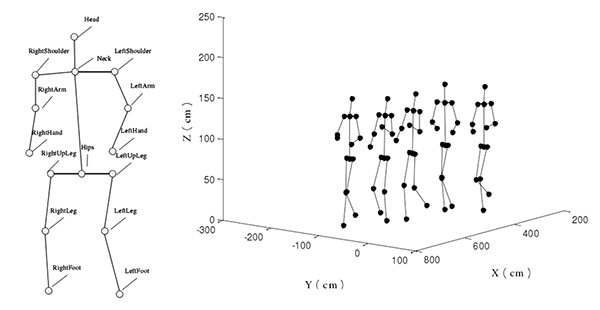

吉林广播电视大学在针对学生上课过程中各种行为与动作的研究中,采用了NOKOV(度量)光学三维动作捕捉系统。系统使用光学动作捕捉镜头捕捉反光标志点(一般称为Marker),获取标志点在三维空间中的坐标,从而通过在身体关键节点处贴点,如手腕、小臂、手肘、大臂、头部等,重建出人体的三维运动模型。学生上课过程中的动作可以总结为:静止、举手、侧身、起立、转头等动作,每个动作对应着各自空间姿态的特征值,如水平运动加速度,垂直方向加速度,躯干夹角,关节夹角等。

研究中利用NOKOV度量光学动作捕捉系统采集大量特征数据,根据特征值来逆推学生上课时的动作。将动作捕捉软件捕捉到的数据实时发送到编译好的程序中,程序会识别到这些特征值的变化,然后判断当前动作,并作出对应提示。例如当学生上课有举手的行为时,NOKOV度量动作捕捉系统准确捕捉到这一动作,将其特征发送到程序中,程序检测到特征值的变化,判断为举手,并通过灯光等方式来提醒老师学生有举手行为。

分析和识别人体的行为动作是一个复杂的工程,可以创造出一种全新的交互方式,通过姿态、手势等动作来进行互动,实现人与环境、人与人的无缝沟通和自由互动。NOKOV度量动作捕捉系统捕捉精度高,能够真实记录下人体关键部位的运动数据,为人体行为识别方向提供可靠的解决方案。