多目立体视觉能够在多种条件下感知三维场景的立体信息,基于多目立体视觉的位姿检测技术以其特有的优势在越来越多的领域扮演着重要的角色。

在航空航天领域,随着越来越多人造飞行器持续地发射进太空,产生了大量的太空垃圾与废弃卫星,若不采取有效措施,有效飞行物被撞击的概率将不断变高。而在清理太空垃圾、修复目标物故障等在轨飞行任务中,需要保证机械臂末端与目标卫星的相对位置,有效的位姿测量方法尤为重要。北京航空航天大学国际交叉科学研究院的蒋催催博士对这一问题进行研究,在传统视觉定位方法上作出两个方向的改进。

一个是在精度上,传统视觉定位算法依赖的参数本身就有一定误差,这些误差在计算过程中更是会被放大。改进的算法选用了5个独立的参数进行空间坐标的转换计算,而且减少了运算中的矩阵转换次数,有效地降低了计算误差,提高了定位精度。另一个是在运算速度上,传统视觉定位算法在坐标转换的计算中非常复杂、耗时颇多,算法改进后,降低了计算过程的复杂度,同时使用了基于FPGA的并行计算方法,大大减少了定位计算所需时间。

完成算法的改进后,需要验证改进算法的有效性。为此,实验室选用了NOKOV(度量)光学三维动作捕捉系统。NOKOV 度量动作捕捉的定位精度达到亚毫米级,并且使用FPGA技术进行边缘计算,输出数据延迟控制在毫秒级别。

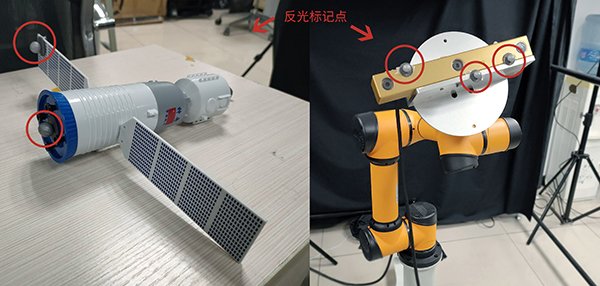

在实验对象——目标卫星模型与机械臂上贴Marker,三个以上动作捕捉镜头能看到这个Marker就能计算出它的三维坐标,从而计算出卫星模型与机械臂的相对位置关系。以动作捕捉系统获取的相对位置作为真值,可有效验证视觉定位算法的精度。